美国《外交》双月刊网站6月5日发表题为《世界应当如何为机器人战争作准备》,作者是美国波士顿东北大学政治学系与国际事务项目副教授、国际控制机器人武器委员会成员丹尼丝·加西亚。

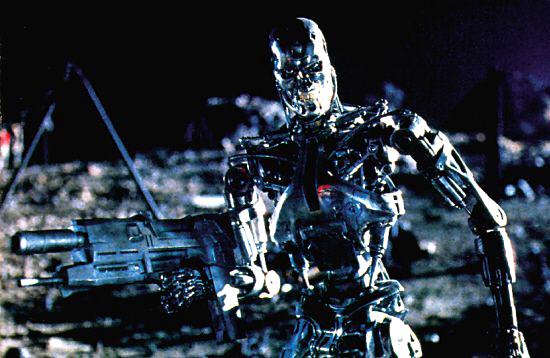

文章说,这个时代的人们发现自己生逢两个武器时代:前有核武器,后有逐渐显现的致命性自主武器。一方面,由于很多国家不履行法定责任,将库存的核武器裁减销毁,核决战的威胁仍然切实存在。另一方面,致命性自主机器人武器让人隐约看到了未来的战争—无人机作为未来自主武器前驱性技术的代表,对它的使用约束规则即便有也是寥寥无几。我们必须制定并强化覆盖武器扩散所有方面全球公认的准则规矩,以保证子孙后代免遭大规模暴力的屠戮。要制定现实可靠的危险武器、新式武器使用国际准则,各国必须为全球合作营造必要的条件。如果世界领袖们希望世界少一点暴力,就必须制定指导方针,改善当前的国际秩序。

丧失武器有效控制

最近,联合国召开了两次会议,探讨核武器库与未来武器方面的紧迫性问题:一个是5月份闭幕的《不扩散核武器条约》缔约国2015年审议大会,另一个是4月份在日内瓦召开的致命性自主武器系统专家会议。每个会议针对一个显著的全球安全威胁:前者着重探讨核战争的风险,后者着重探讨致命性自主军用机器人技术日益增长的风险。

尽管这些问题很重要,但是两个会议最终都无功而返:广岛和长崎遭受核弹袭击已经过去了70年,核扩散仍然威胁着全球安全。1968年缔结的《不扩散核武器条约》到今年已经是第47个年头了,但许多国家仍然仰仗落伍的法律体系应对这一年代久远的技术,看不到任何进一步切实裁军的迹象。与此同时,美国等国正在研究致命性机器人技术,这种技术可以在战争中提供自主援助—鉴于现有样机的能力,恐怕在不久的将来就能在战场上看到这些科研产物。考虑到无人机的扩散以及它们在美国外交政策中的地位,似乎新兴的军事学说认为自主装备是最佳的防御选项,使得华盛顿可以避免伤亡,不管误杀与民众对无人机技术的看法,把部队送上战场。换句话说,人类对战斗丧失有效控制似乎逐渐成为未来一种现实的可能。

法律滞后于新技术

维持核武器同时研发致命军用机器人是保障国家安全的一条造价高昂又危险的策略。这些技术产物有可能扩散到流氓国家或组织,更会恶化冲突,加剧暴力与犯罪,增加恐怖主义袭击的风险。要抑制这些威胁,国际社会应当从现有准则中寻找指针。例如,强大的全球准则禁止使用化学武器,新技术产品问世后,可以比照这套规则制定相关准则。例如,2014年的《武器贸易条约》根据长期人权实践与国际法对常规武器的转让进行管控。这份条约制定了很高的国际准则禁止武器转让,规定了各国维护贸易禁运的责任,使人权法得到切实落实。这套模式对现有武器很管用,但对未来的致命性机器人和其他自主作战技术来说,预防性禁令可能有助于从源头上规避高价危险技术的扩散。例如,“阻止杀手机器人运动组织”呼吁实施禁令,而不要采用先造再禁的追加性禁令做法—这样不致于白白送掉许多生命,也可以避免旷日持久的国际争论。

致命性作战技术研发与法律体系之间存在明显差距。《国际人道主义法》被迫总是跟在新武器技术后面扮演追赶者的角色,还要等若干国家对新武器完成试验后才能将这些武器视为国际法管辖的对象。至今《国际人道主义法》没有对无人机—诞生好几年的技术—进行管控,这让国际社会几乎不相信,未来它会对可能出现的自主性致命武器采取行动。

转载请注明:北纬40° » 是时候为“机器人战争”做准备了